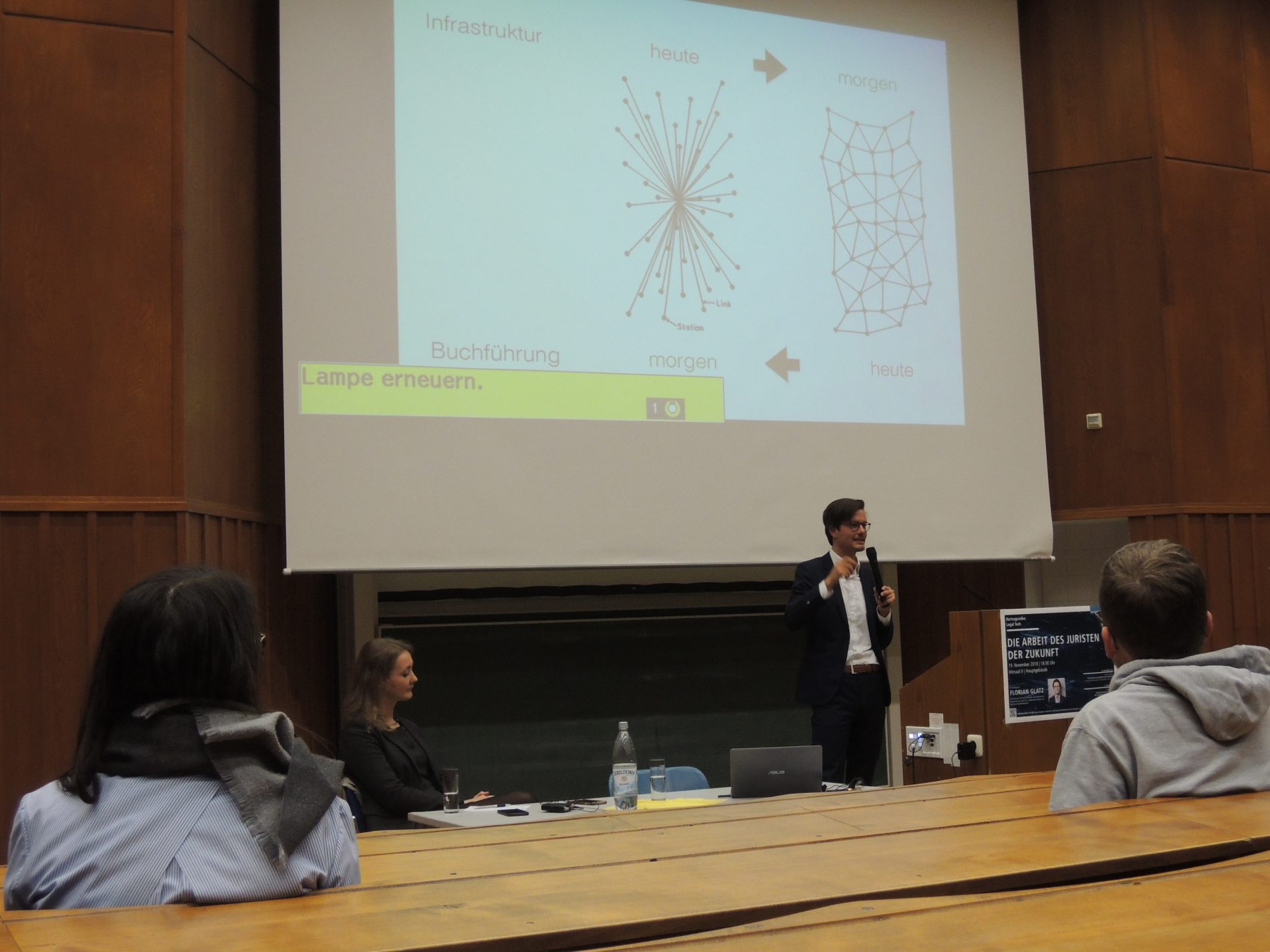

Kann Künstliche Intelligenz (KI) den Juristen (schon) ersetzen? Eine Frage, die in der Legal Tech-Szene auf fast jeder Veranstaltung gestellt wird. Am 17. Januar machte RA Michael Grupp, Geschäftsführer und Gründer des Legal Tech-Unternehmens BRYTER GmbH, mit seinem Vortrag an der Universität zu Köln (Teil der Vortragsreihe Legal Tech) deutlich, dass Juristen sich zuerst andere Fragen stellen müssen.

Bevor Michael Grupp auf das eigentliche Thema des Abends einging, musste er die Technikoptimisten unter seinen Zuhörern zunächst gehörig bremsen: Jede neue technologische Errungenschaft wecke erst einmal übergroße Erwartungen und werde von seinen Anhängern maßlos überschätzt bis sich der Hype normalisiere, wie das unter Tech-Liebhabern bekannte Gartner Hype Cycle of Emerging Technologies veranschaulicht – so auch bei Künstlicher Intelligenz (KI) und juristischer Entscheidungsfindung.

So funktioniert juristische Entscheidungsautomation

Weiter ging es mit einem knappen Überblick der Techniken juristischer Entscheidungsautomation. Auch wenn der aktuelle Hype um Legal Tech es vermuten lässt, Rechtinformatik – die Wissenschaft hinter automatischer Entscheidungsfindung – ist absolut nichts Neues. Schon seit den 60er-Jahren experimentieren Juristen mit IT. In den 80er-Jahren beschäftigte man sich insbesondere mit verschiedenen Arten von Expertensystemen. Die Erkenntnisse haben bis heute Gültigkeit, konkret zusammengefasst lassen sich folgende Ansätze verfolgen:

- Das deduktive System – ein Entscheidungssystem, das aus sich selbst heraus funktioniert. Im Falle von Jura baut man den menschlichen bzw. juristischen Entscheidungsprozess technisch nach.

- Statistischer Ansatz – die Maschine kommt über Datenanalyse, Stochastik und Korrelationen zu einer juristischen Entscheidung.

Den zweiten Ansatz veranschaulichte Grupp am Beispiel von Bilderkennung, um zu zeigen, wie Maschinen „lernen“. Ihre Methode unterscheidet sich auf den ersten Blick nicht viel vom menschlichen Weg: So wie wir Menschen von Erfahrungen lernen, versuchen Maschinen aus einem Datenpool, bestimmte Muster filtern und festzuhalten. Schwierig, aber nicht unmöglich wird es, wenn eine Maschine den Unterschied zwischen einem Chihuahua und einem Blaubeer-Muffin erkennen soll, wie folgendes Bild zeigt:

Hat die Maschine erst einmal erkannt, dass der wesentliche Unterschied zwischen Hundegesicht und Gebäck in der Symmetrie liegt, entwickelt er daraus einen Algorithmus. Je mehr Daten ihm dabei zur Verfügung stehen, desto mehr kann er dieses Muster verfeinern.

Warum juristisches Denken KI überfordert

Anhand der Plakativität des Hunde-Muffin-Beispiels machte Grupp den Unterschied zu juristischen Inhalten deutlich: Diese bestehen nicht aus Bildern, sondern aus Wörtern – deren Bedeutung ist in Abhängigkeit von Syntax und Semantik keineswegs eindeutig, sondern vom Kontext, der persönlichen Interpretation, aber auch vom kulturellem Hintergrund sowie dem Wissensstand des Empfängers abhängig. Auch aus diesem Grund antworten Juristen auf scheinbar simple Fragen fast immer mit „Es kommt darauf an!“.

KI weiß nicht, dass sie etwas nicht weiß – Juristen schon

„Weil Sprache so komplex ist, lassen sich juristische Inhalte nicht ohne Weiteres formalisieren und für die digitale Verarbeitung aufbereiten, also in Algorithmen packen wie Bilder oder Zahlen“, erklärte Michael Grupp. Hier werde auch der wesentliche Unterschied zwischen Wissen und Daten deutlich: „Nur wer bereits Wissen hat, kann neue, interpretationsbedürftige Daten umfassend verarbeiten. Man bezieht unbekannte Komponenten mit ein soweit es irgendwie geht. So etwas einer Maschine beizubringen, gelingt kaum.“ Wo eine Maschine bei ‚normaler Sprache‘ schon Schwierigkeiten habe, würde es bei juristischen Begriffen wie Fahrlässigkeit oder Haftungsklausel fast unmöglich, zu denken wie ein Jurist, erklärte Michael Grupp.

KI kann keine Unwahrscheinlichkeiten einbeziehen

Während KI dem Menschen in Sachen Sprachanalyse weit unterlegen ist, kann sie – wenn es um Datenanalyse geht – umso mehr: „Eine Maschine kann Rückfälligkeitsquoten nutzen, um vorherzusehen, ob ein Straftäter rückfällig werden könnte.“ Diese Technik ist bereits unter dem Stichwort „Predictive Policing“ bekannt und kommt auch im Deutschen Rechtssystem zum Einsatz. Sollte jedoch jemand, der laut statistischer Wahrscheinlichkeit wieder ein Verbrechen begehen könnte, im Gefängnis bleiben? Was ist mit Unwahrscheinlichkeiten? „KI ist wie in den Rückspiegel zu schauen und nach vorne zu denken“, verdeutlichte Grupp die Problematik, die hinter dieser Vorgehensweise steckt. Leittragende derartiger Verfahren seien vor allem Minderheiten. Durch statistische Manifestation wiederholten sich Vorurteile und ließen keinen Raum mehr für Veränderungen zu. Eine Maschine kann nur denken: männlich, schwarz, arm = mit hoher Wahrscheinlichkeit strafanfällig. Die Individualität und Wandelbarkeit einer jeden Person blieben dabei unberücksichtigt.

Von der Rechtsdienstleistung zum Rechtsprodukt

Was kann KI dann überhaupt noch, werden sich viele Zuhörer gefragt haben? Nachdem Grupp die Grenzen Künstlicher Intelligenz aufzeigte, erläuterte er dessen Möglichkeiten: „Es geht nicht darum, den Juristen komplett zu ersetzen. Aber KI unterstützt in seiner Tätigkeit. Zum Teil kann sie auch helfen, Produkte herzustellen, die verkäuflich sind. Juristische Produkte gibt es bisher gar nicht – mit Ausnahme von Verträgen. Technologie kann helfen, juristisches Denken auch skalierbar anzubieten.“

Dabei betonte Grupp die unternehmerischen Probleme: Bei Beratungsleistungen korrelieren Aufwand und Ertrag. Solange die Beratung individuell erfolgt, bleiben Skaleneffekte aus. Bei Produkten können Kosten ab einem bestimmten Punkt konstant bleiben. Als Beispiel nannte Grupp hier das Unternehmen Flightright. Die Entscheidungsgrundlage, ob jemand seine Fluggastrechte einklagen kann, funktioniere jedoch allein auf der syntaktischen Ebene. Um interpretierbare Feinheiten ginge es dabei nicht. An Maschinen, die semantische Entscheidungsfindung durchführen, arbeitet die Rechtsinformatik noch.

KI kann Anwälten helfen, Zeit zu sparen

Michael Grupp selbst hat mit BRYTER ein Programm entwickelt, mit dem Juristen Wissen und Entscheidungswege ohne Programmierkenntnisse abbilden und in Form einer Software bzw. einer App automatisieren können. Juristen werden dadurch nicht ersetzt, ersparen sich aber eine Menge Arbeitszeit. „Was Monate dauert, kann in einer Woche erledigt sein“, so Grupp.

Wie bei Google & Co.? Konzentration juristischer Anbieter

Was können Juristen aus diesem Ansatz lernen? „Die Juristen von morgen müssen lernen, ziel- statt problemorientiert zu denken! Nur weil man mehr Anwälte hat, heißt das nicht, dass man automatisch mehr Recht bekommt.“ Neben dem Aufruf zu stärkerem Effizienzdenken sagte Grupp auch, dass es in Zukunft eine stärkere Bündelung von Rechtsdienstleistung geben werde. Ähnlich wie bei Google, Apple & Co. könnten sich durch den Informationsfluss im Internet die Ströme im juristischen Markt in Zukunft auf ein paar wenige Anbieter konzentrieren. Die Frage, ob das wiederum gewollt ist, blieb offen.

In der anschließenden Diskussionsrunde stellten sich Grupp und das Publikum außerdem noch entscheidende rechtsphilosophische Fragen:

- Wenn Künstliche Intelligenz den Juristen ersetzen kann, ist das überhaupt wünschenswert?

- Wenn Künstliche Intelligenz den Juristen ersetzen kann, gibt es Bereiche, die allein in der Hand des Menschen bleiben sollten?

- Wenn Künstliche Intelligenz den Juristen ersetzen kann, wie muss die Juristenausbildung der Zukunft aussehen?

Die Frage, ob KI den Juristen (schon) ersetzen kann, lässt sich, ganz im Sinne der juristischen Denke, also – wenn überhaupt – mit einem „Es kommt darauf an!“ beantworten.

Bilder: FFI-Verlag/@teenybiscuit

Bettina Taylor arbeitet als Produktmanagerin und Redakteurin beim FFI-Verlag. Als studierte Online-Journalistin gehören SEO, webgerechtes Texten und Content-Marketing zu ihren Spezialgebieten. ffi-verlag.de

Pingback: Vortragsreihe Legal Tech: Zu den gegenwärtigen Grenzen Künstlicher Intelligenz bei der juristischer Entscheidungsfindung | NEWS - WALDORF FROMMER

Pingback: KI (Künstliche Intelligenz) in Anwaltskanzleien - KanzLaw